Um Ihnen die Funktionen unseres Online-Shops uneingeschränkt anbieten zu können setzen wir Cookies ein. Weitere Informationen

NVIDIA DGX Station™

Der KI-Supercomputer für den Schreibtisch. Für Forschung, Lehre und souveräne KI.

Bis zu 20 PFLOPS KI-Leistung, 748 GB kohärenter Speicher und Modelle mit bis zu 1 Billion Parametern – lokal, DSGVO-konform, ohne Cloud-Abhängigkeit. Angetrieben vom NVIDIA GB300 Grace Blackwell Ultra Desktop Superchip.

Rechenzentrums-Leistung. Direkt am Arbeitsplatz.

Angetrieben vom NVIDIA GB300 Grace Blackwell Ultra Desktop Superchip. Für Training, Fine-Tuning und Inferenz großer KI-Modelle, lokal am Arbeitsplatz und DSGVO-konform.

Warum die DGX Station?

Große KI-Modelle lokal zu betreiben war bisher der öffentlichen Cloud oder dedizierten Rechenzentren vorbehalten. Die DGX Station verändert das: Frontier-Modelle laufen direkt im Institut – mit voller Datenhoheit, planbaren Kosten und Enterprise-Software ab Werk.

Produktionsreif ab Auslieferung

DGX OS 7, CUDA-X, NeMo, TensorRT-LLM, NIM und Mission Control vorinstalliert und von NVIDIA validiert. Erste Modelle laufen innerhalb von Minuten.

Volle Datenhoheit

Trainingsdaten, Gewichte und Logs bleiben im Institut. DSGVO-, EU-AI-Act- und Schrems-II-konform ohne Drittlandübertragung.

Planbarer als Cloud

Einmalige CAPEX-Investition, kalkulierbare Stromkosten, keine Stundenzähler und keine Egress-Gebühren. Break-even gegenüber Cloud-Miete in 12 bis 18 Monaten.

Team-Sharing per MIG

Bis zu 7 isolierte GPU-Instanzen mit garantierter QoS für parallele Doktoranden, Lehrveranstaltungen oder Experiment-Pipelines.

Blackwell Ultra für Reasoning

Zweite Generation Transformer Engine mit nativer NVFP4-Präzision und 2-facher Attention-Beschleunigung. Entwickelt für agentische KI und Reasoning-Modelle.

Elite Partner mit SuperPOD-Erfahrung

Einer der wenigen NVIDIA Elite Partner in Deutschland mit produktiver SuperPOD-Erfahrung. Seit 1985 am Markt, mit eigenem Test Center in Glinde.

Technische Spezifikationen

Weltklasse-Hardware in einem geräuscharmen Tower-Gehäuse für den Schreibtisch. 1.600 W Gesamtleistung – betreibbar an einer Standard-Bürosteckdose.

Alle Angaben ohne Gewähr. Tensor-Core-Spezifikationen mit Sparsity sofern nicht anders gekennzeichnet.

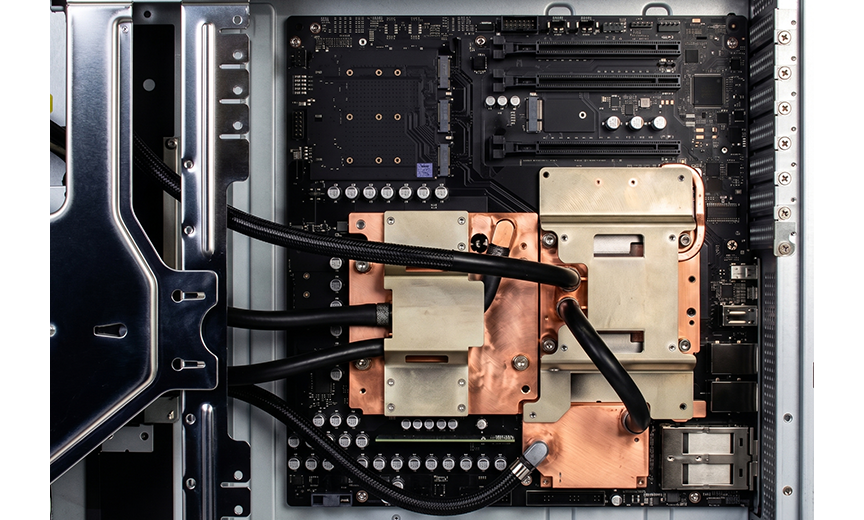

Geschlossener Kühlkreislauf

Closed-Loop Flüssigkeitskühlung für leisen, bürotauglichen Betrieb bei 1.600 W Systemleistung.

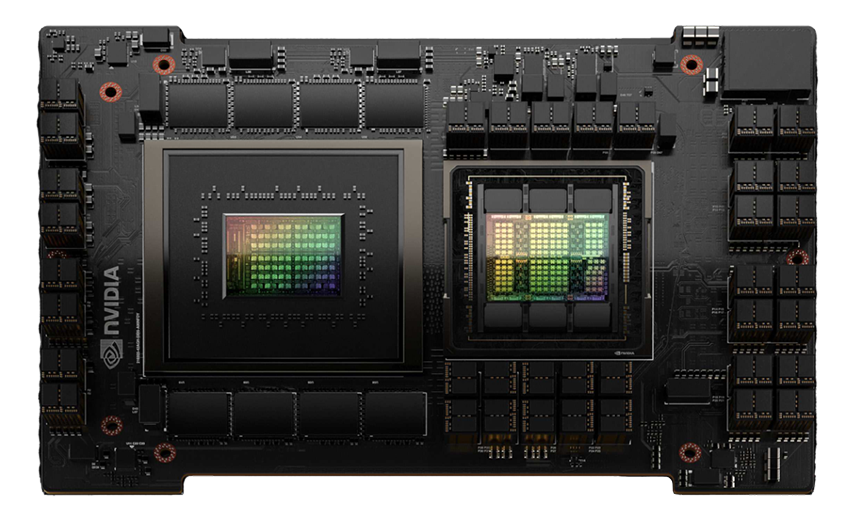

GB300 Superchip

Grace-CPU und Blackwell-Ultra-GPU kohärent verbunden über NVLink-C2C mit 900 GB/s.

ConnectX-8 Networking

Zwei QSFP-Ports mit je 400 GbE. Zwei Stations koppelbar ohne externen Switch.

Architektur, die neue Maßstäbe setzt

Fünf Durchbrüche machen die DGX Station zur ersten Workstation, die Frontier-KI wirklich lokal möglich macht.

Blackwell Ultra GPU

Doppelter Attention-Durchsatz, 1,5-fache Dense-FP4-Leistung und 50 Prozent mehr HBM gegenüber Standard-Blackwell. Inferenz-optimiert für Reasoning-Modelle, multimodale KI und agentische Systeme.

NVLink-C2C: 748 GB als ein Pool

Die 900 GB/s NVLink-C2C-Verbindung macht Grace-CPU und Blackwell-Ultra-GPU zu einem kohärenten Speicherpool: 252 GB HBM3e plus 496 GB LPDDR5X – rund das Siebenfache der PCIe-Gen-5-Bandbreite. 1-Billion-Parameter-Modelle laufen ohne Sharding.

ConnectX-8 SuperNIC: 800 Gb/s

Erster NIC mit On-Die-PCIe-Gen-6-Switch. Zwei DGX Stations koppeln direkt zu einem logischen System – rund 1,5 TB kohärenter Speicher und 40 PFLOPS FP4, ohne separaten Switch.

NVFP4: Inferenz 3,5× kompakter

4-Bit-Float-Format mit unter 1 % Abweichung gegenüber FP8 bei ~3,5-fach kleinerem Speicherbedarf gegenüber FP16. Ein 1-Billion-Parameter-Modell wiegt rund 500 GB – passt in die 748 GB der Station. TensorRT-LLM, vLLM und SGLang unterstützen NVFP4 nativ.

Grace CPU, 72 Arm-Neoverse-V2-Kerne

Über NVLink-C2C direkt kohärent mit der Blackwell-Ultra-GPU verbunden. 396 GB/s LPDDR5X-Bandbreite – rund das Dreifache typischer DDR5-Server, bei geringerer Leistungsaufnahme. Vermeidet PCIe-Transfers zwischen CPU und GPU.

Für Forschung und Lehre

Die DGX Station bringt Frontier-Workloads an den Arbeitsplatz von Universitäten, Fachhochschulen, Universitätskliniken und forschungsnahen Unternehmen. Lokale Inferenz, agentisches Reasoning und multimodale Generierung sind ohne Umweg in die Cloud möglich.

| Anwendungsfeld | Typische Modelle / Frameworks |

|---|---|

| Training & Inferenz von LLMs | Llama 4 Maverick, Qwen3-235B, DeepSeek-V3.2, Mistral Large 3, Nemotron |

| LoRA / QLoRA Fine-Tuning | Domänenspezifische Modelle auf eigenen Daten |

| Multimodale KI & VLMs | Cosmos, FLUX.2, Vision-Language-Modelle |

| Agentische KI & Reasoning | Chain-of-Thought, Best-of-N, Tool-Use |

| Life Sciences & Medizin | BioNeMo, MONAI, FLARE (föderiertes Lernen) |

| Physical AI & Robotik | Isaac, Omniverse, Holoscan, Digital Twins |

| Scientific Computing | RAPIDS, CUDA-X, Simulation |

Modellgrößen auf einer Station

Dank 748 GB kohärentem Speicher und nativer NVFP4-Präzision skalieren Workloads weit über das hinaus, was bisher eine einzelne Workstation leisten konnte. Zwei Stations lassen sich über ConnectX-8 zu einem logischen System koppeln.

| Workload | Machbare Modellgröße |

|---|---|

| Inferenz (NVFP4) | Bis zu ~1 Billion Parameter |

| Inferenz (FP8) | ~400 Mrd. dense / 671 Mrd. MoE |

| LoRA / QLoRA Fine-Tune | 200 bis 400 Mrd. (MoE / NVFP4-quantisiert) |

| Full Fine-Tune (BF16) | ~70 Mrd. in HBM; 200 Mrd. mit LPDDR |

| Multi-User-Betrieb (MIG) | Bis zu 7 isolierte GPU-Partitionen |

| Token-Durchsatz | 250.000 Tokens/Sekunde (NVIDIA CES 2026) |

| Zwei gekoppelte Stations | ~1,5 TB Speicher / 40 PFLOPS FP4 |

Vom Schreibtisch zur AI Factory

Ein durchgängiger CUDA-Stack – vom Einzelplatz bis zur Exascale-Referenzarchitektur. Code, den Sie auf der DGX Station entwickeln, läuft unverändert auf DGX B300-Servern und im DGX SuperPOD.

DGX Spark

GB10 Superchip

128 GB Unified

1 PFLOP FP4

Mini-PC, 170 W

Einzelentwickler, Lehre, Prototyping

DGX Station

GB300 Superchip

748 GB kohärent

20 PFLOPS FP4

Desktop, 1.600 W

Lehrstuhl, Institut, Forschungsgruppe

DGX B300

8× Blackwell Ultra

2,3 TB HBM3e

144 PFLOPS FP4

10U Rack, ~15 kW

Rechenzentrum, AI Factory

DGX SuperPOD

GB300 NVL72 Rackscale

Bis zu 576 GPUs / SU

Exaflop-Klasse

Referenzarchitektur

Exascale-KI, Frontier-Training

Entwickeln am Schreibtisch. Skalieren ins Rechenzentrum.

Die DGX Station ist das institutsnahe Pendant zu DELTAs größeren NVIDIA-Infrastrukturen – ständig verfügbar, DSGVO-konform und vollständig im Haus. Wachsende Workloads skalieren auf DGX B300-Server oder DGX SuperPOD-Systeme aus DELTA-Planung, mit identischem CUDA-Stack und portierbarem Code.

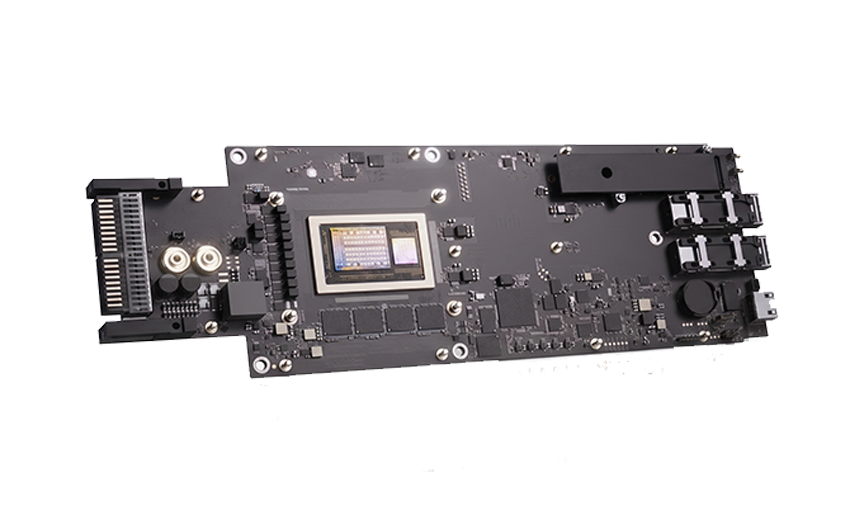

Drei Varianten. Eine Frontier-KI.

DELTA liefert die DGX Station in drei OEM-Ausführungen auf Basis des identischen NVIDIA GB300-Superchip-Referenzdesigns. Die Wahl trifft Formfaktor, Design-Sprache und Service-Ökosystem, nicht die Rechenleistung.

MSI XpertStation WS300

- Kompaktes Tower-Chassis für den Arbeitsplatz

- 1.600 W Titanium-Netzteil

- MSI-Fertigung mit Herstellergarantie

Supermicro Super AI Station

- Flexibles Chassis: Tower oder 19-Zoll-Rack-Montage

- 1.600 W Titanium-Netzteil

- Supermicro-Fertigung mit Herstellergarantie

Gigabyte W775-V10-L01

- Pedestal-Tower mit Premium-Design

- 1.600 W Platinum-Netzteil

- Gigabyte-Fertigung mit Herstellergarantie

| Merkmal | MSI XpertStation WS300 | Supermicro Super AI Station | Gigabyte W775-V10-L01 |

|---|---|---|---|

| Formfaktor | Tower | Tower / Rack optional | Tower |

| Abmessungen (B × H × T) | 248 × 528 × 583 mm | 218 × 455 × 701 mm | 218 × 520 × 726 mm |

| Netzteil | 1.600 W Titanium | 1.600 W Titanium | 1.600 W Platinum |

| PCIe-Erweiterung | 1× Gen5 x16 + 2× Gen5 x8 | 1× Gen5 x16 + 2× Gen5 x8 | 1× Gen5 x16 + 2× Gen5 x8 |

| Betriebstemperatur | 10 – 30°C | 10 – 25°C | 10 – 35°C |

Vollständiger KI-Software-Stack ab Werk

Die DGX Station wird mit einem komplett vorinstallierten und von NVIDIA validierten Software-Stack ausgeliefert. Erste Modelle laufen innerhalb von Minuten – nicht Wochen.

NVIDIA AI Enterprise & Mission Control

NVIDIA AI Enterprise bietet Enterprise-Support und über 100 validierte Frameworks. Mission Control orchestriert Jobs, MIG-Partitionen und Cluster-Verbünde aus zwei gekoppelten DGX Stations. 90-Tage NVAIE-Testlizenz inklusive; Vollversion über DELTA erhältlich.

CUDA-X, NeMo, TensorRT-LLM

CUDA 13+, cuDNN, cuBLAS, NCCL, RAPIDS, PyTorch, TensorFlow, JAX. NeMo-Framework für Retriever und Megatron-LM-Training. TensorRT-LLM ab 0.15 mit nativer NVFP4-Unterstützung. Triton Inference Server für skalierbare Inferenz.

NIM Microservices & Blueprints

Vorkonfigurierte NIM-Microservices für Llama Nemotron, Cosmos, Nemotron 3 sowie Modelle von Drittanbietern (Llama, Mistral, Qwen, DeepSeek). Blueprints für Wissensgraphen, Retrieval-Pipelines und sichere autonome Agenten.

Open-Source & Third-Party

Hugging Face Hub, vLLM, SGLang, Ollama, llama.cpp (mit NVIDIA-Optimierungen), LLaMA Factory sind offiziell unterstützt. DGX Spark Playbooks (GitHub) bieten 40+ fertige Rezepte – die Station-Versionen folgen fortlaufend.

Damit bauen Sie autonome KI-Agenten on-premise: das NVIDIA Agent Toolkit (NemoClaw, OpenShell, Nemotron) direkt auf der DGX Station. Mehr zur Lösung KI-Agenten on-premise.

Unser Anwenderkreis

Seit vier Jahrzehnten liefert DELTA Rechenleistung für Forschung, Lehre und Industrie in der DACH-Region. Die folgenden Einrichtungstypen bilden den Kern unserer DGX-Projekte.

⬢ | Universitäten & Hochschulen Über 40 Universitäten, Fachhochschulen und Technische Hochschulen deutschlandweit – von Lehrstühlen für Maschinelles Lernen über Informatik-Institute bis zu Fachbereichen der Produktionstechnik. |

✚ | Universitätskliniken & Medizin Universitätskliniken und biomedizinische Forschungszentren – für KI in medizinischer Bildgebung, Genomik, klinischer Entscheidungsunterstützung und Infektionsforschung. |

◉ | Außeruniversitäre Forschung Fraunhofer-, Helmholtz-, Max-Planck- und Leibniz-Einrichtungen sowie weitere öffentliche Forschungsträger – für Grundlagen- und angewandte Forschung auf aktueller NVIDIA-Hardware. |

⊞ | Industrie & Wirtschaft Forschungsnahe Unternehmen in Deutschland und Europa – von Maschinenbau und Chemie über Medien und Finanzdienstleister bis zu KI-Unternehmen mit eigener Modellentwicklung. |

◈ | Öffentliche Hand Bundes- und Landeseinrichtungen, öffentliche Forschungsträger und akademische Infrastrukturbetreiber mit hohen Anforderungen an Datenhoheit und Betriebssicherheit. |

◆ | Startups & Scale-ups Forschungsnahe Startups und KI-Unternehmen – häufig über das NVIDIA Inception-Programm begleitet, mit Sonderkonditionen für junge Unternehmen in der Aufbauphase. |

DELTA Computer – Ihr NVIDIA Elite Partner

Einer der wenigen deutschen NVIDIA Elite Partner mit realer SuperPOD-Deployment-Erfahrung. Seit 1985 begleiten wir Universitäten, Fachhochschulen, Forschungsinstitute, Universitätskliniken und forschungsnahe Unternehmen – von der Konzeption bis zum produktiven Betrieb, auf Deutsch aus Glinde bei Hamburg.

★

NVIDIA Elite Partner

Höchste Partnerstufe seit 2018

⬢

SuperPOD-Erfahrung

Europas erster DGX GB200 NVL72 realisiert für DeepL

◎

Test Center Glinde

DGX-Systeme vor dem Kauf live testen

⊞

Forschung & Lehre

Lieferung frei Haus innerhalb Deutschlands

Zertifizierungen & Auszeichnungen

ISO 9001 Qualitätsmanagement | ISO 14001 Umweltmanagement | ISO 27001 Informationssicherheit | EcoVadis Gold Top 5 % Nachhaltigkeit | 3× Star Performer NVIDIA Central Europe Award |

Leistungen rund um die DGX Station

| ◆ | Unabhängige Beratung zur Systemauslegung und zu Skalierungspfaden |

| ◆ | Freibleibende Angebote inklusive Preis- und Lieferinformationen |

| ◆ | Lieferung ab Lager Glinde; Forschung & Lehre frei Haus in Deutschland |

| ◆ | Optionale Installation und Inbetriebnahme vor Ort |

| ◆ | Benchmarking im Deep Learning Test Center Glinde (aktuell DGX B300 live) |

| ◆ | Deutschsprachige Kundenbetreuung seit 1985 |

| ◆ | Beratung zu Re-Export-Bestimmungen gem. US-/EU-Regularien |

Seit 1985 aus Hamburg

Vier Jahrzehnte Systemintegration für deutsche Forschung und Industrie.

Jedes System, das DELTA ausliefert, wurde im Haus konzipiert, integriert und in Betrieb genommen – vom einzelnen Server bis zu den ersten produktiven DGX SuperPODs in Europa.

Standort & Erreichbarkeit

DELTA Computer Products GmbH

Am Alten Lokschuppen 4

21509 Glinde

Mo–Fr 07:30–18:30

Lieferzeit: ca 4–10 Wochen

DGX Station Dossier von DELTA

Ausführliche technische und kommerzielle Aufbereitung der NVIDIA DGX Station mit GB300 Grace Blackwell Ultra Desktop Superchip: OEM-Varianten im Vergleich, Workload-Empfehlungen, DFG-Antrags-Hinweise und Skalierungspfade. Erstellt für Beschaffungsteams in Forschungseinrichtungen.

Häufig gestellte Fragen

Antworten für Forschungsgruppen, Lehrstühle, Klinik-IT und Beschaffungsverantwortliche – strukturiert nach Themenbereichen. Technische Begriffe sind im Glossar am Ende der Seite kurz erklärt.

Produkt & Leistung

Was ist die NVIDIA DGX Station und wofür ist sie gedacht?+

Die NVIDIA DGX Station ist ein Deskside-KI-Supercomputer mit GB300 Grace Blackwell Ultra Desktop Superchip, 748 GB kohärentem Speicher und bis zu 20 PFLOPS FP4-Leistung. Sie ist für Entwicklung, Fine-Tuning und Inferenz von KI-Modellen bis etwa 1 Billion Parameter direkt am Arbeitsplatz konzipiert – für einzelne Forschende oder Teams mit bis zu sieben parallelen MIG-Nutzern.

Welche Modellgrößen kann ich auf einer DGX Station trainieren?+

Bei LoRA und QLoRA sind Modelle mit 200 bis 400 Mrd. Parametern machbar. Full Fine-Tuning läuft bis etwa 70 Mrd. Parameter im HBM-Speicher. Bei Inferenz mit NVFP4 sind Modelle bis ca. 1 Billion Parameter umsetzbar. Zwei gekoppelte Stations über ConnectX-8 verdoppeln die Kapazität auf rund 1,5 TB.

Wie unterscheidet sich die DGX Station von einem DGX B300-Server?+

Die DGX Station ist ein Deskside-System mit einem GB300 Superchip, 748 GB kohärentem Speicher und bis zu 20 PFLOPS FP4. Sie adressiert Entwicklung, Fine-Tuning und Inferenz am Arbeitsplatz. Der DGX B300-Server ist ein 10U-Rack-System mit 8 Blackwell-Ultra-GPUs, etwa 2,3 TB HBM3e und rund 144 PFLOPS FP4. Er ist für produktive Workloads im Rechenzentrum ausgelegt. Beide Systeme nutzen denselben CUDA-Stack, Code ist portierbar. Die Station ist der Schreibtisch-Counterpart zum B300 für Entwicklung und Fine-Tuning, der B300 die produktive Skalierung im Rechenzentrum.

Welche zusätzlichen GPUs kann ich in die DGX Station einbauen?+

Unterstützt werden NVIDIA RTX PRO 6000 Blackwell (Workstation Edition oder Max-Q), RTX PRO 4000 SFF und RTX PRO 2000 Blackwell Generation über PCIe Gen 5. Diese können parallel zum GB300 für grafikintensive Simulation, Visualisierung oder zusätzliche Inferenz-Instanzen genutzt werden.

Kann ich zwei DGX Stations miteinander koppeln?+

Ja. Jede DGX Station verfügt über einen integrierten NVIDIA ConnectX-8 SuperNIC mit bis zu 800 Gb/s. Zwei Stations lassen sich ohne externen Switch zu einem logischen System koppeln. Das ergibt rund 1,5 TB kohärenten Speicher und 40 PFLOPS FP4, was lokales Training größerer MoE-Modelle und Reasoning-Workloads ermöglicht. DELTA unterstützt Sie bei Umsetzung und Installation vor Ort.

Warum brauche ich eine DGX Station und nicht eine Workstation mit RTX 5090?+

Consumer-GPUs wie eine RTX 5090 in einer Ryzen- oder Threadripper-Workstation liefern hohe Leistung für einzelne Nutzer. Bei modernen KI-Workloads stoßen sie jedoch an klare architektonische Grenzen. Der Grafikspeicher von 32 GB GDDR7 deckt Modelle bis etwa 30 Mrd. Parameter ab, darüber hinaus wird geteilt oder gewartet. Die DGX Station liefert dagegen 252 GB HBM3e plus 496 GB LPDDR5X in einem kohärenten 748-GB-Adressraum und ermöglicht Inferenz bis rund 1 Billion Parameter.

Hinzu kommen native NVFP4-Präzision, bis zu 7 isolierte MIG-Instanzen für parallele Nutzer, ein 800-Gb/s-ConnectX-8-SuperNIC, der NVIDIA AI Enterprise Software-Stack (separat lizenzierbar) sowie zertifizierte OEM-Hardware für den Dauerbetrieb. Kurz gesagt: Eine Consumer-Workstation ist ein Einzelplatzgerät für Experimente. Die DGX Station ist ein Deskside-Supercomputer für Team-Arbeit auf Frontier-Modellen.

Infrastruktur & Betrieb

Wie hoch ist der Stromverbrauch und welche Infrastruktur brauche ich?+

Die Gesamt-Systemleistung liegt bei 1.600 W. Die Station ist mit einer geschlossenen Flüssigkeitskühlung (closed-loop liquid cooling) ausgestattet. Der Kühlkreislauf ist komplett im Gehäuse integriert, eine externe Kühlinfrastruktur ist nicht erforderlich. Der Betrieb erfolgt an einer regulären 230-V-Stromversorgung über eine 16-A-Anbindung oder ein C19-Kaltgerätekabel. Kein Rechenzentrums-Setup, keine Raumklimatisierung, leiser Betrieb im Büro oder Labor.

Welche Software ist vorinstalliert?+

Auf der Station sind NVIDIA DGX OS 7 (Ubuntu 24.04), CUDA-X, NeMo, Triton, TensorRT-LLM, NIM sowie NVIDIA Mission Control vorinstalliert. Ein 90-Tage-Test von NVIDIA AI Enterprise (NVAIE) ist enthalten. MIG erlaubt bis zu 7 isolierte GPU-Instanzen für parallele Nutzer.

Wie laut ist die DGX Station im Büro?+

Die DGX Station ist für Bürobetrieb ausgelegt und deutlich leiser als klassische Rack-Server. Im Idle- oder typischen Entwicklungsbetrieb arbeitet sie unauffällig; unter Volllast (Training) ist ein hörbares Lüftergeräusch wahrnehmbar, bleibt aber im Rahmen einer geräuscharmen Workstation. Für sensible Akustikumgebungen empfiehlt DELTA die Aufstellung in einer Nebenkabine oder einem separaten Technikraum.

Welche Netzwerkumgebung empfehlen Sie?+

Die DGX Station bringt ein integriertes 10-GbE-Management-Netzwerk und einen ConnectX-8 SuperNIC mit bis zu 800 Gb/s mit. Für Mehrbenutzerbetrieb oder die Anbindung an hochperformanten Storage empfiehlt DELTA NVIDIA-Spectrum-Switches und NVMe-Storage-Systeme (etwa mit Xinnor xiRAID). Wir planen die komplette Netzwerk-Topologie individuell.

Beschaffung & Finanzierung

Kann ich die DGX Station über einen DFG-Großgeräteantrag finanzieren?+

Ja. Geeignete Förderwege sind u. a. Forschungsgroßgeräte nach Art. 91b GG (50 % Bund, 50 % Land), Großgeräte der Länder, Sachbeihilfen ab 50.000 € brutto sowie Pilotprogramme zur Ertüchtigung. Angebote dürfen höchstens 3 Monate alt sein, müssen brutto inklusive MwSt. ausgewiesen werden und werden über das elan-Portal eingereicht. DELTA erstellt auf Anfrage fristgerechte, vollständige Angebotsunterlagen passend zu Ihrem Förderweg.

Welche Lieferzeit muss ich einplanen?+

Die typische Lieferzeit liegt bei 4 bis 10 Wochen ab verbindlicher Bestellung, abhängig von OEM und gewählter Konfiguration. DELTA bietet die DGX Station in drei Varianten an: MSI XpertStation WS300 (CT60-S8060), Supermicro Super AI Station (ARS-511GD-NB-LCC) sowie Gigabyte W775-V10-L01. Wir priorisieren Forschungskunden. Aktuelle Verfügbarkeiten bestätigen wir Ihnen auf Anfrage.

Gibt es EDU-Rabatte oder besondere Konditionen für Forschungseinrichtungen?+

NVIDIA bietet Education-Konditionen für akkreditierte Forschung und Lehre sowie Startup-Konditionen über das NVIDIA Inception-Programm. DELTA prüft Ihre Anspruchsberechtigung und berücksichtigt entsprechende Konditionen direkt im Angebot.

Welche Leasing- oder Finanzierungsmodelle gibt es?+

Neben Direktkauf bietet DELTA Leasing über ausgewählte Bankpartner an. Die Konditionen prüfen wir individuell. Für mehrjährige Großgeräte-Budgets oder drittmittelbasierte Projekte erstellen wir gestaffelte Angebote passend zu Ihrer Finanzierungsstruktur. Bitte sprechen Sie uns frühzeitig an, damit wir die geeignete Variante gemeinsam prüfen können.

Compliance & Datenschutz

Gibt es US-Exportkontrollvorgaben beim Kauf der DGX Station?+

Ja. Die NVIDIA DGX Station unterliegt wie andere fortgeschrittene KI-Hardware den US-Exportkontrollbestimmungen nach der Advanced Computing Chip Rule. Für Lieferungen innerhalb Deutschland, Österreich und Schweiz (DACH) sind in der Regel keine zusätzlichen US-Lizenzpflichten erforderlich. Für alle Zielländer außerhalb der DACH-Region bitten wir Sie, DELTA vor der Bestellung zu kontaktieren, insbesondere bei Empfängern in gelisteten Staaten der US-Regelung. Wir prüfen die Zulässigkeit individuell und unterstützen bei erforderlichen BAFA-Verfahren nach AWG/AWV.

Wie hilft die DGX Station bei DSGVO- und EU-AI-Act-Konformität?+

Als On-Premise-System findet keine Drittlandsübertragung statt; Schrems II und CLOUD-Act-Exposition entfallen. Volle Kontrolle über Trainingsdaten und Logging erleichtern die Dokumentationspflichten für Hochrisiko-KI-Systeme nach EU AI Act ab dem 2. August 2026. Die Forschungsausnahme nach Art. 2 Abs. 6 gilt während der Forschungs- und Entwicklungsphase.

Eignet sich die DGX Station für ISO-27001-zertifizierte Umgebungen?+

Ja. Die DGX Station wird über NVIDIA DGX OS 7 auf Basis von Ubuntu 24.04 LTS geliefert – mit regelmäßigen Security-Updates und voller Kontrolle über Patch-Management, Benutzer- und Rollenkonzepte. DELTA selbst ist ISO-27001-zertifiziert und berät bei der Integration der DGX Station in bestehende ISMS-Prozesse, insbesondere bei Wartungszugriffen, Logging und Geräte-Lifecycle.

Support, Skalierung & Test

Wann ist die DGX Station die richtige Wahl gegenüber einem Rechenzentrum?+

Die DGX Station ist das ständig verfügbare Institutsgerät – ohne Antragsverfahren, ohne Warteschlangen, ohne Drittlandsübertragung. Größere Rechenzentrumsressourcen bieten mehr Rohleistung, aber mit geteilter Nutzung und Planungsvorlauf. Typischer Workflow: Entwicklung, Debugging und Prototyping auf der Station, anschließend Skalierung auf DGX B300-Server oder DGX SuperPOD für finale Trainingsläufe – derselbe CUDA-Stack, Code-Transfer ohne Refactoring.

Wie erhalte ich Support und Wartung?+

Die DGX Station ist ein OEM-Produkt. DELTA liefert sie je nach Präferenz als MSI XpertStation WS300, Supermicro Super AI Station oder Gigabyte W775-V10-L01 auf Basis des NVIDIA GB300 Superchips. Die Hardware-Gewährleistung läuft entsprechend über den jeweiligen OEM. Üblich sind 3 Jahre Basis-Laufzeit mit optionalen Erweiterungen. DELTA übernimmt als Integrator die deutschsprachige Betreuung aus Glinde: Installation, Inbetriebnahme, Ansprechpartner und laufende Beratung.

Auf der Software-Ebene ist ein 90-Tage-Test von NVIDIA AI Enterprise (NVAIE) inklusive; eine Vollversion mit Enterprise-Software-Support kann separat über DELTA lizenziert werden.

Kann ich die DGX Station vor dem Kauf testen?+

Ja – DELTA betreibt in Glinde bei Hamburg ein Deep Learning Test Center, in dem DGX-Systeme live getestet und eigene Workloads benchmarkt werden können. Aktuell steht dort bereits eine DGX B300; die DGX Station GB300 folgt in Kürze. Terminvereinbarungen erfolgen über unser Anfrageformular.

Wie skaliere ich später von der DGX Station auf größere Systeme?+

Derselbe NVIDIA-Stack (CUDA, NeMo, TensorRT-LLM, Mission Control) läuft auf DGX Station, DGX B300-Server und DGX GB300 NVL72. Code ist ohne Änderungen portierbar. DELTA berät Sie bei der Planung des Skalierungspfads und unterstützt bei der Umsetzung, vom Einzelgerät über gekoppelte Stations bis zu DGX B300-Servern oder DGX-SuperPOD-Referenzarchitekturen. Als Integrator des ersten DGX GB200 NVL72 SuperPOD in Europa bringen wir die nötige Projekterfahrung mit.

Begriffe in 30 Sekunden

16 Schlüsselbegriffe rund um die DGX Station, von GB300 bis MIG.

Bringen Sie Frontier-KI an Ihren Schreibtisch

Beratung, individuelle Konfiguration oder Testlauf im Deep Learning Test Center Glinde – wir unterstützen Sie unverbindlich bei der Planung Ihrer KI-Infrastruktur.

Kontakt: Tel. +49 40 300672-0 | Fax +49 40 300672-11 | E-Mail info[at]delta.de